Linux内网离线安装Ollama

在线安装

在线安装Ollama非常简单,只需访问https://ollama.com/download,选择适合您的服务器系统,然后按照步骤完成安装即可。

离线安装

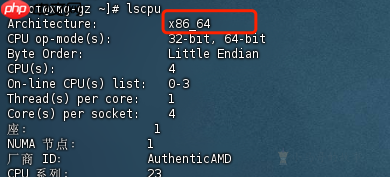

首先,您需要查看服务器的CPU型号。使用以下命令可以查看Linux系统的CPU型号:

## 查看Linux系统CPU型号命令,我的服务器cpu型号是x86_64 lscpu

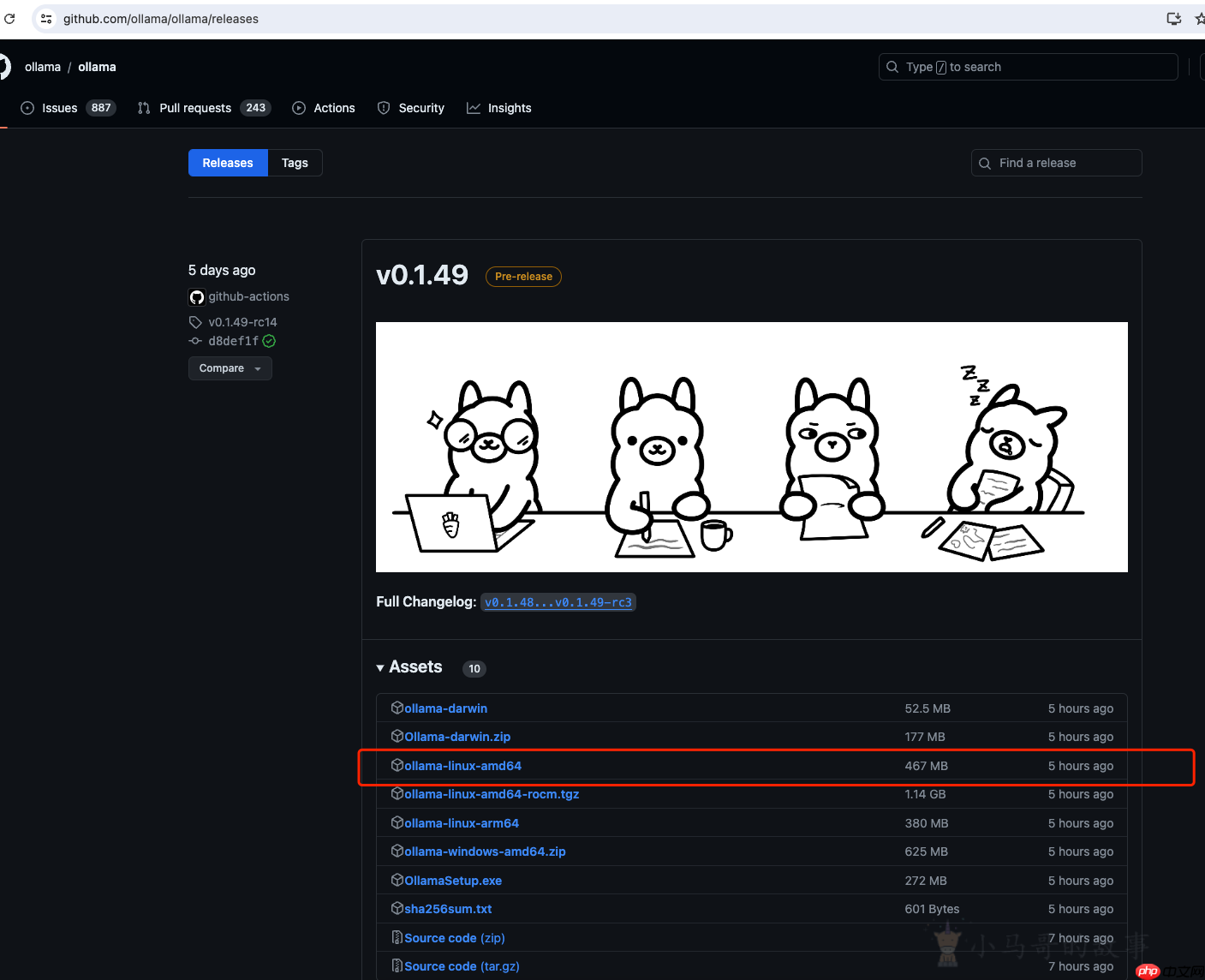

根据CPU型号从以下地址下载Ollama安装包:

https://www.php.cn/link/f220707c3afe39d1779e0a34af72bb7f

# x86_64 CPU选择下载ollama-linux-amd64 # aarch64|arm64 CPU选择下载ollama-linux-arm

接下来,您需要下载Linux环境的Ollama安装脚本。可以通过以下地址下载:

## 下载地址1,浏览器中打开下面地址 https://ollama.com/install.sh ## 下载地址2 https://github.com/ollama/ollama/blob/main/scripts/install.sh

修改install.sh脚本时,需要注意两个关键点:Ollama下载地址和Ollama安装包存放目录。

首先,注释掉下载链接:

status "Downloading ollama..."

## 在install.sh的第65行

#curl --fail --show-error --location --progress-bar -o $TEMP_DIR/ollama "https://ollama.com/download/ollama-linux-${ARCH}${VER_PARAM}"然后,修改ollama安装目录:

status "Installing ollama to $BINDIR..." ## 在install.sh的第73行 #$SUDO install -o0 -g0 -m755 $TEMP_DIR/ollama $BINDIR/ollama $SUDO install -o0 -g0 -m755 ./ollama-linux-amd64 $BINDIR/ollama

运行install.sh脚本进行安装:

# 执行installl.sh脚本,需要sudo 权限 chmod +x install.sh ./install.sh # 如果报错误权限不足,执行 chmod +x install.sh

运行大模型,如通义千问:

SLStuan手拉手团购程序(仿拉手网)

SLStuan手拉手团购程序(仿拉手网)

手拉手团购系统是一套Groupon模式的开源团购程序,是骏商网络(dream3.cn)旗下开发的一套仿拉手网团购程序,是国内首套采用ASP+MSSQL开发的团购程序,安装超简,功能超全面,在保留手拉手团购系统版权的前提下,允许所有用户永久免费使用、永久免费升级。手拉手团购系统内置多种主流在线支付接口,所有网银用户均可无障碍支付;短信发送团购券和实物团购快递发货等。 SLStuan手拉手团购程序 v

0

查看详情

0

查看详情

# 需要先将大模型下载到OLLAMA_MODELS文件中 # ollama run ollama run qwen2:7b

关闭Ollama服务:

# 关闭ollama服务 service ollama stop

Ollama常用命令:

## 启动Ollama服务 ollama serve ## 从模型文件创建模型 ollama create ## 显示模型信息 ollama show ## 运行模型 ollama run 模型名称 ## 从注册表中拉去模型 ollama pull 模型名称 ##将模型推送到注册表 ollama push ## 列出模型 ollama list ## 复制模型 ollama cp ## 删除模型 ollama rm 模型名称 ## 获取有关Ollama任何命令的帮助信息 ollama help

FAQ

如何查看运行的日志?

在Linux上运行命令journalctl -u ollama,即可查看运行日志。

如何配置本地大模型对局域网提供服务?

在Linux上修改配置文件,并配置环境变量 OLLAMA_HOST 来指定对局域网提供服务的地址,再重启Ollama服务即可。

vim /etc/systemd/system/ollama.service 在[Service]下面加上: Environment="OLLAMA_HOST=0.0.0.0:11434"

重启后,就可以通过http在局域网中访问了。

下载的大模型存储在哪个路径?

默认情况下,不同操作系统存储的路径如下:

macOS: ~/.ollama/models Linux: /usr/share/ollama/.ollama/models Windows: C:\Users<username>.ollama\models

本文由 小马哥 创作,采用 知识共享署名4.0 国际许可协议进行许可。本站文章除注明转载/出处外,均为本站原创或翻译,转载前请务必署名。

以上就是Linux内网离线安装Ollama的详细内容,更多请关注其它相关文章!

将模型推送到注册表

ollama push

## 列出模型

ollama list

## 复制模型

ollama cp

## 删除模型

ollama rm 模型名称

## 获取有关Ollama任何命令的帮助信息

ollama help

将模型推送到注册表

ollama push

## 列出模型

ollama list

## 复制模型

ollama cp

## 删除模型

ollama rm 模型名称

## 获取有关Ollama任何命令的帮助信息

ollama help